최근 AI 개발 커뮤니티와 기술 전문가들 사이에서 SWE-bench Verified의 신뢰성에 대한 의문이 뜨겁게 달아오르고 있습니다. 오랫동안 최첨단 AI 모델의 코딩 능력을 측정하는 데 있어 가장 공신력 있는 지표로 여겨졌던 이 벤치마크가, 이제는 그 본래의 역할을 제대로 수행하지 못한다는 지적이 잇따르고 있기 때문입니다. 특히 오픈AI를 비롯한 주요 기업들이 이 벤치마크를 더 이상 최상위 모델의 코딩 능력을 판단하는 기준으로 삼지 않기로 공식적으로 입장을 밝히면서, 기술계의 시선이 집중되고 있습니다.

이 변화의 배경에는 두 가지 결정적인 문제가 자리 잡고 있습니다. 먼저, 벤치마크 자체의 테스트 케이스가 가진 구조적 결함입니다. 수백 개의 문제 중 상당수가 지나치게 구체적인 구현 세부사항을 요구하거나, 문제 문장에 명시되지 않은 기능을 테스트하는 등 너무 광범위한 조건을 담고 있어, 실제로는 정상적으로 작동하는 솔루션까지도 틀린 것으로 판정하는 오류가 발생했습니다. 이는 모델의 진정한 코딩 능력을 왜곡하여 보여줄 수밖에 없는 치명적인 약점이었습니다.

더 큰 문제는 학습 데이터 오염 현상입니다. 현재 시판 중인 최첨단 모델들이 SWE-bench Verified에 포함된 문제와 정답 코드를 이미 학습 데이터로 접했을 가능성이 매우 높다는 사실이 드러났습니다. 모델이 문제를 푸는 능력이 아니라, 단순히 이전에 본 데이터를 기억해 내는 성능을 보여주는 경우가 많아진 것입니다. 이로 인해 벤치마크 점수의 상승이 실제 코딩 능력의 향상보다는 학습 데이터 노출에 의한 결과일 가능성이 크다는 비판이 제기되었습니다.

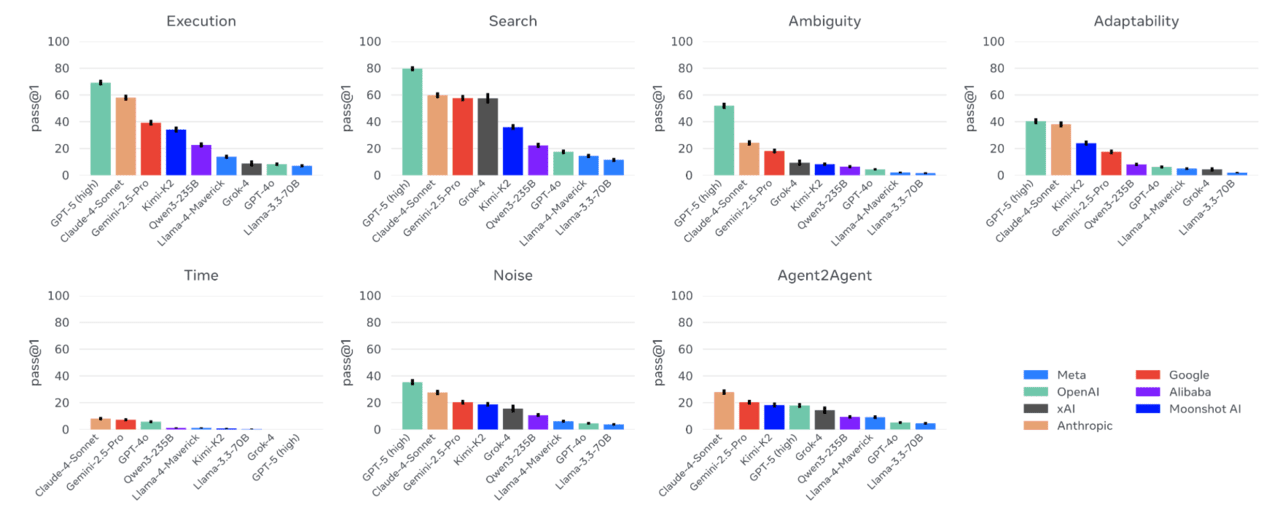

이러한 상황은 업계 전반에 새로운 평가 기준을 요구하는 흐름을 만들었습니다. 단순히 공개된 데이터셋을 기반으로 한 벤치마크가 아닌, 모델 출시 시점에 맞춰 새로 작성되거나 비공개로 유지되는 벤치마크의 필요성이 강조되고 있습니다. 특히 실제 업무 환경과 유사한 복잡한 과제를 수행하는 능력을 측정하기 위해, 데이터 오염의 우려가 적은 SWE-bench Pro와 같은 차세대 지표로 눈을 돌리는 움직임이 활발해지고 있습니다. 기술의 발전 속도가 빨라질수록 벤치마크 역시 빠르게 구식이 될 수밖에 없다는 현실을 직시하며, 업계는 더 투명하고 공정한 평가 방식을 찾기 위한 고민을 이어가고 있습니다.