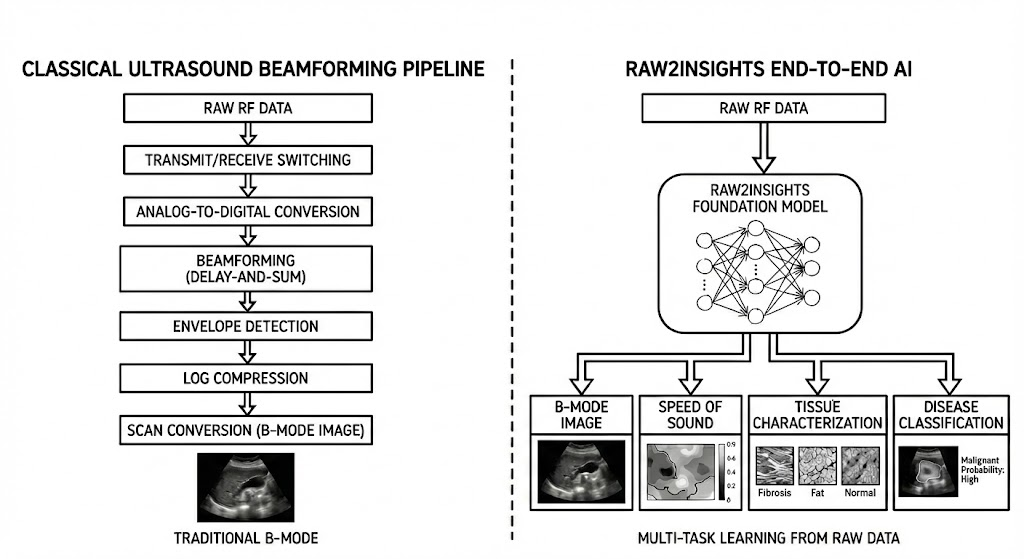

오랜 시간 동안 초음파는 안전하고 실시간으로 결과를 확인할 수 있으며 휴대가 간편하다는 이유로 의료 영상 분야에서 독보적인 위치를 차지해 왔습니다. 하지만 우리가 화면에서 보게 되는 이미지는 사실 복잡한 과정을 거쳐 만들어진 결과물일 뿐입니다. 과거 수십 년간 사용되어 온 방식은 손으로 설계된 재구성 파이프라인을 통해 방대한 양의 원시 센서 데이터를 압축하고, 인체 내 음속이 일정하다는 단순한 물리학적 가정을 전제로 이미지를 만들어냈습니다. 이 과정에서 소리가 조직을 통과하며 남기는 미세한 정보나 복잡한 신호의 뉘앙스는 대부분 생략되거나 단순화되어 사라져 버렸습니다.

최근 주목받는 흐름은 바로 이 지점에서 시작됩니다. 인공지능과 기반 모델의 발전이 의료 영상에도 새로운 질문을 던진 것입니다. 완성된 이미지를 바탕으로 분석하는 것을 넘어, 초음파 프로브가 포착한 원시 신호 그 자체에서 직접 학습할 수 있을까요? 그리고 재구성 과정에서 버려졌던 정보들을 다시 활용한다면 어떤 새로운 가능성이 열릴까요. 엔비디아와 지멘스 헬스니어스의 연구진이 이 질문에 답하기 위해 손을 맞잡은 결과물이 바로 물리 정보를 반영한 NV-Raw2Insights-US AI 모델입니다.

이 기술의 핵심은 초음파가 단순한 그림이 아니라 ‘소리’라는 사실에 집중하는 데 있습니다. 임상가가 화면에서 보는 것은 몸속에서 반사되어 돌아오는 수백만 개의 작은 에코들이 모여 만든 재구성된 그림이지만, 그 과정에는 소리가 실제로 조직을 어떻게 통과하고 상호작용했는지에 대한 풍부한 정보가 담겨 있습니다. 새로운 접근법은 이 재구성 단계보다 훨씬 앞선 시점으로 눈을 돌려 프로브가 포착한 가장 원초적인 신호를 학습의 출발점으로 삼습니다. 이를 통해 모델은 각 환자가 소리를 어떻게 고유하게 변형시키는지 더 섬세하게 ‘듣고’ 이해할 수 있게 됩니다.

이러한 변화는 단순한 기술적 개선을 넘어 의료 진단의 패러다임을 바꾸는 신호탄이 될 수 있습니다. 원시 데이터에서 직접 통찰을 얻는 엔드 투 엔드 AI 의 실현은 앞으로 초음파 영상이 제공할 수 있는 정보의 깊이를 한층 더 확장할 것입니다. 이제 초음파는 더 이상 고정된 공식을 적용한 결과물이 아니라, 환자 개개인의 생체 신호에 맞춰 적응적으로 진화하는 지능형 도구로 거듭나고 있습니다. 의료 현장에서 소리의 미세한 떨림까지 읽어내는 이 새로운 시대가 열어갈 진단의 가능성에 많은 이의 시선이 집중되고 있습니다.