개발자들의 코드 리뷰 워크플로우에 지각변동이 일어나고 있습니다. 최근 클로드 코드(Claude Code) 기반의 새로운 오픈소스 프로젝트가 등장하며, 단순한 자동화를 넘어선 ‘다중 에이전트 리뷰’가 실제 버그를 잡아내는 효율성에서 기존 도구들을 압도한다는 평가가 나오고 있습니다. 이는 더 이상 AI 가 단순히 코드를 읽어주는 수준을 넘어, 서로 다른 관점을 가진 여러 에이전트가 협력하여 심층 분석을 수행하고, 그 결과를 바탕으로 자동 수정 루프를 돌리는 정교한 시스템이 가능해졌음을 의미합니다.

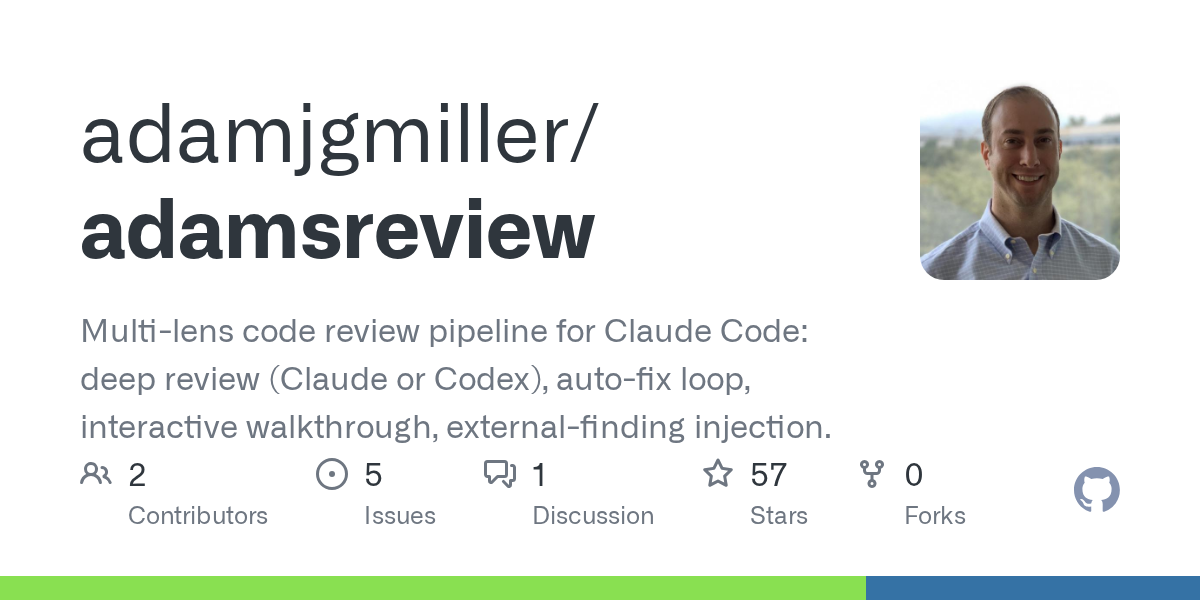

이러한 변화의 중심에는 ‘adamsreview’라는 프로젝트가 있습니다. 이 도구는 클로드 코드와 코덱스(Codex) 같은 다양한 모델을 병렬로 가동하여 심층 리뷰를 수행하고, 발견된 문제를 JSON 상태로 유지하며 자동 수정을 시도합니다. 특히 기존 클로드의 내장 리뷰 기능이나 코드라빗, 그레파일 같은 상용 도구들보다 실제 버그를 더 많이 포착하면서도 오탐지는 줄였다는 사용자들의 경험담이 주목을 끄는 핵심입니다. 단순히 코드를 스캔하는 것을 넘어, 외부 컨텍스트를 주입하고 대화형으로 검토 과정을 진행할 수 있다는 점이 개발자들에게 새로운 가능성을 제시하고 있습니다.

하지만 이 새로운 흐름에 대한 반응은 단순히 찬사만은 아닙니다. 일부 개발자들은 “클로드가 클로드에게 지시를 내려 클로드의 코드를 리뷰하게 한다”는 구조가 복잡성을 해결하기 위해 또 다른 복잡성을 만들어내는 것은 아닌지 의문을 제기하기도 합니다. 특히 토큰 소모량과 비용 효율성에 대한 우려도 함께 제기되는데, 이는 고도화된 리뷰가 실제 생산성에 얼마나 기여할 것인지에 대한 실용적인 고민을 반영합니다. 그럼에도 불구하고, 특히 프로덕션 코드처럼 쉽게 버릴 수 없는 중요한 코드를 다룰 때 에이전트 간의 상호 검증이 주는 안정감은 무시할 수 없는 매력으로 작용하고 있습니다.

앞으로 주목해야 할 점은 이러한 멀티 에이전트 방식이 어떻게 더 정교한 지시어와 컨텍스트 관리로 진화할 것인지입니다. 너무 포괄적이거나 반대로 지나치게 구체적인 리뷰 지시어 사이에서 균형을 찾는 과정이 핵심 과제가 될 것입니다. 단순한 자동화를 넘어, 개발자가 AI 와 함께 코드를 더 깊이 있게 성찰할 수 있는 파트너십으로 발전할지, 아니면 과도한 토큰 소모로 인해 특정 고가치 프로젝트에만 국한될지 여부는 향후 실제 사용 사례들을 통해 확인할 수 있을 것입니다. 코드 품질을 높이는 방식이 단순한 스캔에서 지능적인 협업으로 넘어가는 이 전환점은 개발 생태계의 미래를 읽는 중요한 신호가 될 것입니다.