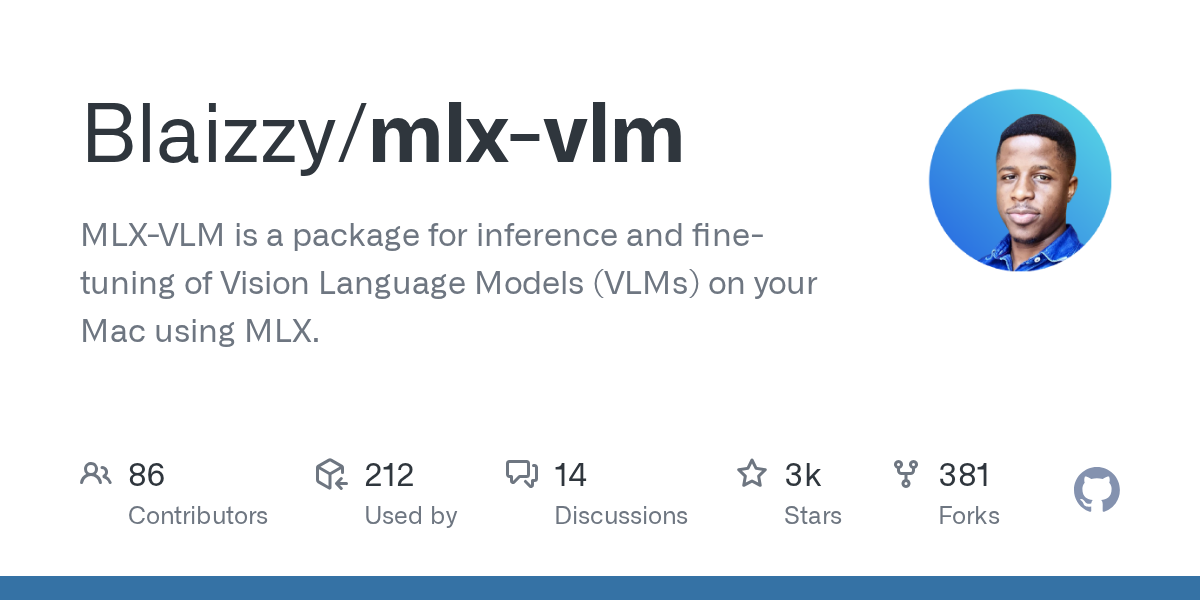

최근 글로벌 오픈소스 커뮤니티에서 맥북 사용자들을 중심으로 MLX-VLM이라는 프로젝트가 급부상하고 있습니다. 이 도구는 애플의 MLX 프레임워크를 활용하여 비전 언어 모델(VLM)을 맥 환경에서 추론하고 미세 조정할 수 있게 해주는 패키지로, 기존의 무거운 클라우드 의존성을 낮추는 데 핵심적인 역할을 하고 있습니다. 단순히 모델을 실행하는 것을 넘어, 이미지와 텍스트를 동시에 이해하는 멀티모달 AI를 개인용 컴퓨터에서 효율적으로 다룰 수 있다는 점이 주목받는 이유입니다.

이 프로젝트가 뜨겁게 달아오른 배경에는 맥 하드웨어의 성능을 AI 연산에 최적화하려는 개발자들의 니즈가 자리 잡고 있습니다. 과거에는 고해상도 이미지를 분석하거나 복잡한 지시어를 처리하려면 막대한 연산 능력을 갖춘 서버가 필수였으나, MLX-VLM을 통해 맥북 프로나 맥 스튜디오 같은 기기에서도 실시간에 가까운 추론이 가능해졌습니다. 실제로 깃허브 트렌딩 차트에서 이 리포지토리가 상위권을 차지하며, 수백 개의 스타가 단기간에 모이는 현상이 발생했습니다. 이는 단순한 호기심을 넘어, 실제 업무 환경에서 즉시 적용 가능한 솔루션을 찾는 개발자들의 적극적인 반응을 보여줍니다.

사용자들의 반응은 구체적인 활용 사례를 중심으로 형성되고 있습니다. 파이썬 명령어를 통해 간단히 설치를 완료하고, 특정 모델을 지정하여 이미지와 함께 질문을 던지는 추론 과정을 거치는 방식이 널리 공유되고 있습니다. 예를 들어, gemma-3-4b-it-4bit 같은 경량화된 모델을 맥 환경에서 구동하여 시각적 데이터를 기반으로 한 답변을 생성하는 실험들이 블로그와 포럼을 통해 활발히 논의되고 있습니다. 이러한 접근법은 비용 부담 없이 AI 모델을 커스터마이징하고 싶어 하는 소규모 팀이나 독립 개발자들에게 큰 매력으로 작용하고 있습니다.

향후 주목해야 할 점은 이 프로젝트의 기능 확장과 커뮤니티의 성장 속도입니다. 현재는 기본적인 추론과 미세 조정에 집중되어 있지만, 배치 처리 기능이나 사용자 인터페이스 개선과 같은 이슈들이 지속적으로 제기되며 발전 방향을 모색하고 있습니다. 특히 대용량 데이터를 한 번에 처리하거나 더 직관적인 채팅 인터페이스를 요구하는 목소리가 커지면서, 단순한 실행 도구를 넘어 완성도 높은 AI 워크플로우 플랫폼으로 진화할 가능성이 높습니다. 맥 기반의 로컬 AI 생태계가 어떻게 확장될지, 그리고 MLX-VLM이 그 중심에서 어떤 표준을 제시할지 지켜볼 필요가 있습니다.