멀티모달 환경에서 언어 간 장벽을 허무는 기술이 급부상하고 있습니다. 특히 IBM 이 공개한 Granite Embedding Multilingual R2 는 기존 임베딩 모델이 겪던 ‘모델 크기와 언어 지원 범위’ 사이의 상충 관계를 획기적으로 좁혔다는 점에서 주목받고 있습니다. 과거에는 1 억 파라미터 미만의 경량 모델을 선택하면 언어 커버리지가 제한되거나, 다국어를 지원하려면 모델이 너무 무거워져 실시간 처리가 어려웠습니다. 하지만 이번 R2 시리즈는 이 두 가지 요구를 동시에 충족시키는 새로운 기준을 제시하며 개발자들 사이에서 뜨거운 반응을 얻고 있습니다.

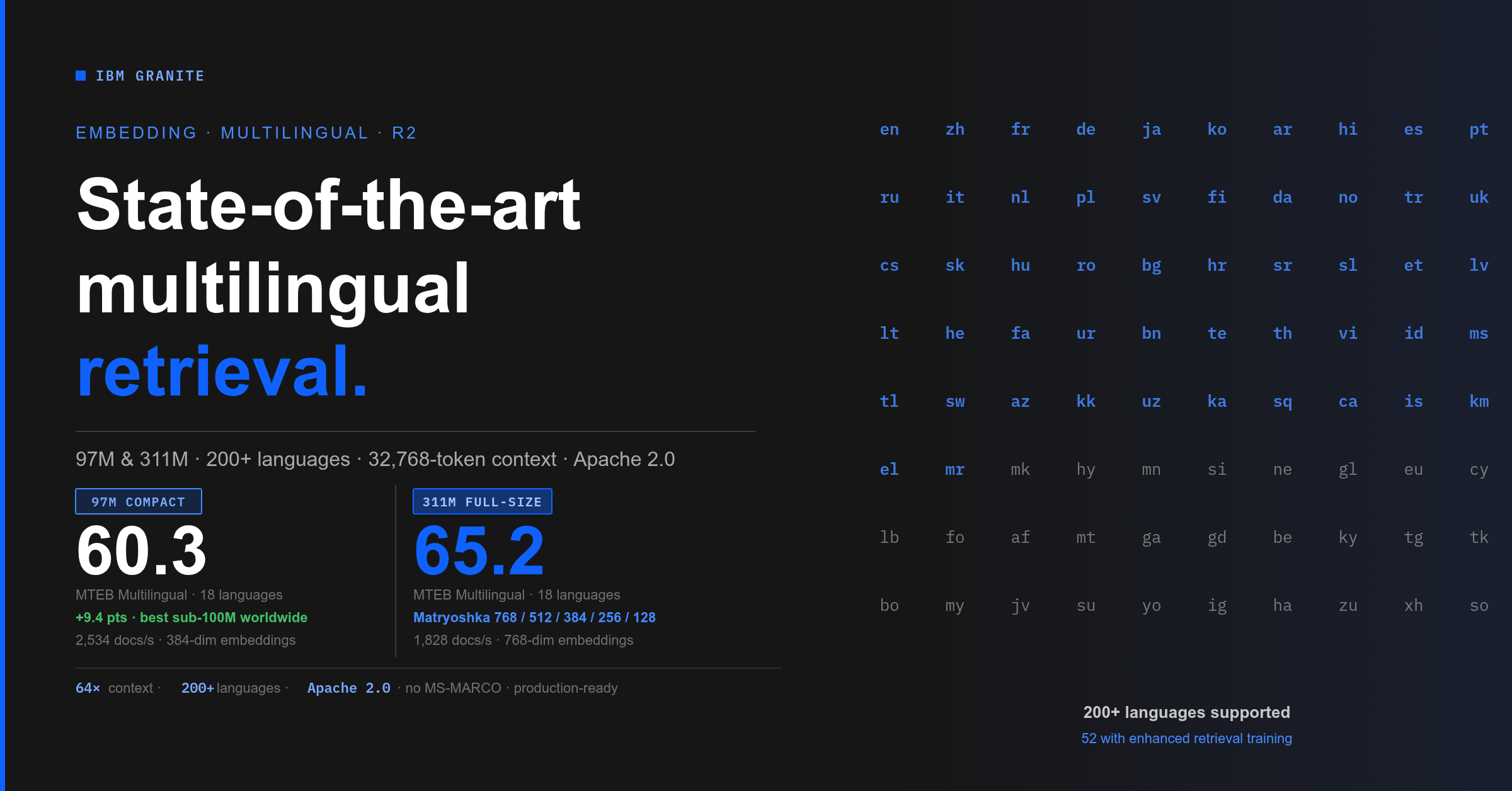

이 모델이 주목받는 핵심 이유는 압도적인 성능과 효율성의 동시 달성입니다. 97M 파라미터의 경량 모델은 MTEB 멀티링구얼 리트리벌 벤치마크에서 60.3 점이라는 기록을 세우며, 1 억 파라미터 미만 오픈소스 모델 중 가장 높은 성능을 입증했습니다. 동시에 311M 파라미터 풀사이즈 모델은 65.2 점으로 오픈소스 5 억 파라미터 미만 모델 중 2 위를 차지했습니다. 더 중요한 것은 이 모델들이 200 개 이상의 언어를 지원하면서도 32K 토큰의 긴 컨텍스트를 처리할 수 있다는 점입니다. 이전 버전인 R1 대비 컨텍스트 길이가 64 배 확장되어 긴 문서나 복잡한 코드 블록을 한 번에 이해하고 검색하는 데 최적화되었습니다.

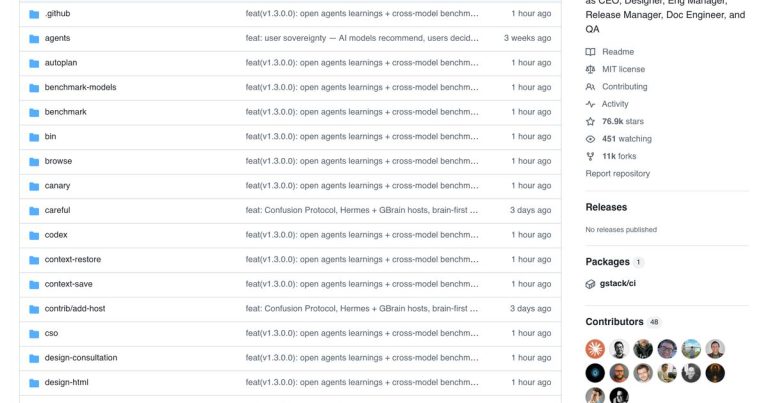

실무 적용 측면에서도 이 모델은 큰 변화를 예고합니다. 9 개 프로그래밍 언어에 대한 코드 리트리벌 기능이 추가되어 국제적인 개발 팀이 서로 다른 언어로 작성된 코드를 검색하고 통합하는 작업이 훨씬 수월해졌습니다. 또한 Apache 2.0 라이선스로 공개되어 기업 환경에서도 별도 비용 부담 없이 자유롭게 배포하고 커스터마이징할 수 있습니다. 매트리ョ시카 임베딩 기술을 지원함으로써 사용자는 필요에 따라 임베딩 차원을 조절하며 저장 공간과 연산 비용을 유연하게 절감할 수 있습니다. 이는 대규모 데이터셋을 다루는 기업이나 리소스가 제한된 스타트업 모두에게 실질적인 이득이 됩니다.

향후 주목해야 할 점은 이 모델이 어떻게 글로벌 AI 생태계의 표준으로 자리 잡을지입니다. IBM 이 제시한 이 기술은 단순한 벤치마크 수치를 넘어, 실제 다국어 환경에서 작동하는 RAG 시스템의 성능 한계를 끌어올리는 역할을 할 것입니다. 특히 오픈소스 기반의 고성능 임베딩 모델이 상용 모델을 위협할 만큼의 품질을 갖추게 되면서, 기업들의 모델 선택 기준이 다시 한번 재편될 가능성이 큽니다. 개발자들은 이제 언어 간 장벽과 모델 크기라는 제약을 덜 받고, 더 정교하고 빠른 검색 시스템을 구축할 수 있게 되었습니다.