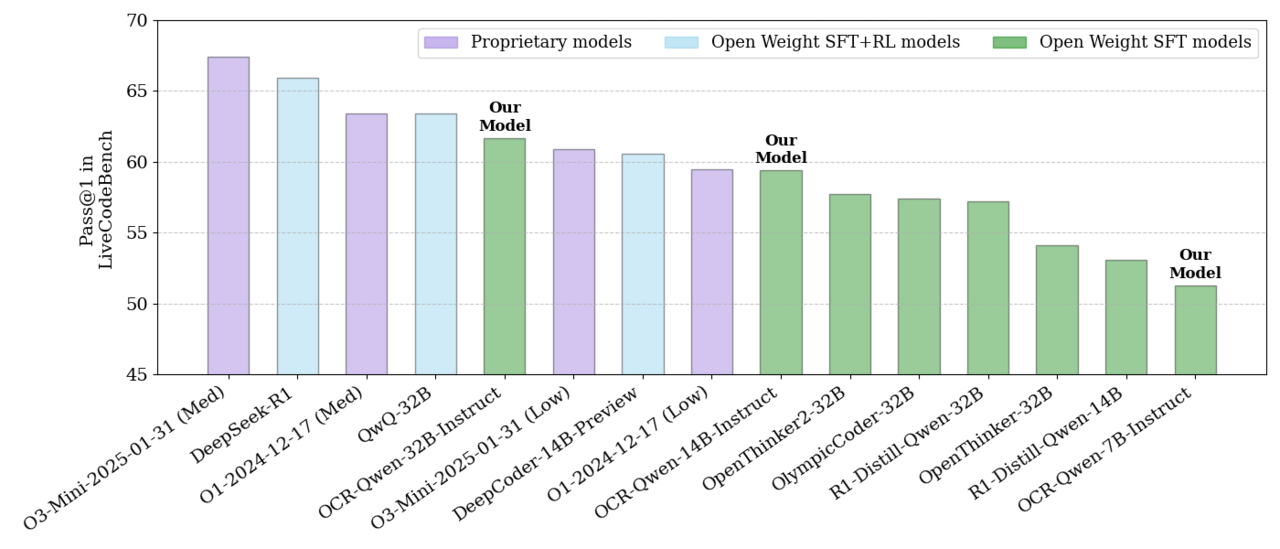

최근 AI 산업계에서 기존의 성능 평가 지표가 한계에 부딪히면서 새로운 평가 기준에 대한 관심이 급격히 높아지고 있다. 특히 람다 계산법 기반의 벤치마크가 주목받는 이유는 단순히 정답을 맞추는 능력을 넘어, 모델이 추상적인 논리 구조를 어떻게 구현하는지를 직접적으로 검증할 수 있기 때문이다. 현재 주요 연구실들의 최상위 모델들은 기존 데이터셋에서 거의 비슷한 점수를 기록하며 치열하게 경쟁하고 있지만, 새로운 문제 유형이 등장할 때마다 그들 사이의 미세한 차이가 드러나고 있다.

이러한 흐름 속에서 람다 계산법을 활용한 LamBench 같은 도구가 등장한 것은 시장의 과열된 마케팅에 대한 냉정한 거울 역할을 하고 있다. 최근 중국을 중심으로 소형 모델들이 기존 최상위 모델을 능가한다는 주장이 쏟아져 나왔지만, 실제 비벤치마크 환경이나 복잡한 논리 과제를 수행할 때 그 한계가 명확히 드러나는 경우가 많다. 일부 모델은 특정 데이터셋에서는 훌륭한 성능을 보이지만, 순수한 람다 식으로 표현된 알고리즘을 구현해야 하는 상황에서는 예상치 못한 오류를 범하기도 한다. 이는 모델이 단순히 데이터를 암기하거나 패턴을 매칭하는 수준을 넘어, 근본적인 계산 논리를 이해하고 있는지를 가르는 중요한 기준이 되고 있다.

산업 구조의 관점에서 볼 때, 이 같은 새로운 벤치마크의 등장은 AI 모델의 진화 방향을 재정의하는 신호로 해석된다. 단순히 파라미터 수를 늘리거나 학습 데이터를 확장하는 방식보다는, 주어진 논리적 제약 안에서 효율적인 코드를 생성하는 능력이 더 중요한 가치로 부상하고 있다. 특히 오픈소스나 로컬 환경에서 구동되는 모델들의 경우, 이러한 순수 논리 테스트에서 얼마나 유연하게 대처하느냐가 실제 업무 적용 가능성을 가르는 핵심 변수가 될 전망이다. 마케팅 문구로 포장된 과장된 성능보다는, 실제 비정형적인 문제 해결 능력을 검증하는 과정이 산업의 성숙도를 가늠하는 지표로 자리 잡을 것이다.

앞으로 주목해야 할 점은 이러한 평가 방식이 어떻게 표준화되어 나갈지, 그리고 이를 통해 어떤 새로운 모델 아키텍처가 등장할지다. 람다 계산법과 같은 수학적 기초에 기반한 평가는 AI 모델이 단순한 언어 처리기를 넘어 논리적 추론 능력을 갖춘 도구로 발전하는지 확인하는 중요한 통로가 될 것이다. 시장 참여자들은 이제 새로운 모델 출시 때마다 즉각적인 성능 비교보다는, 이러한 근본적인 논리 테스트에서의 성과를 면밀히 살펴보는 경향을 보일 것으로 예상된다. 이는 AI 기술이 양적 성장이 아닌 질적 도약을 향해 나아가고 있음을 시사하는 중요한 흐름이다.