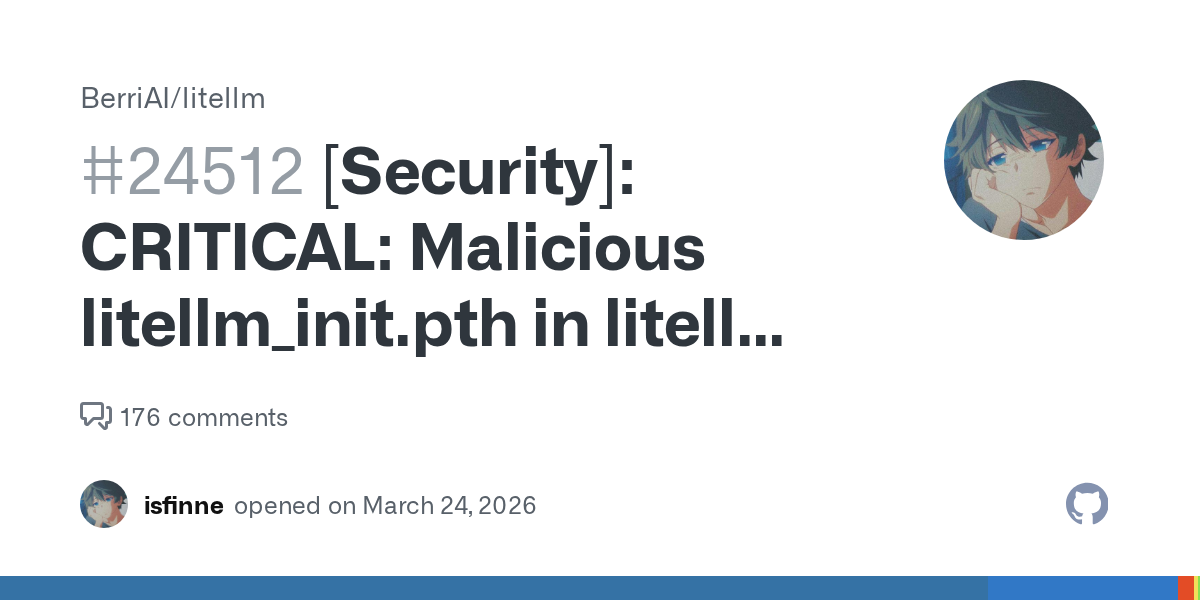

최근 글로벌 개발자 커뮤니티를 뜨겁게 달구고 있는 이슈는 오픈소스 AI 라이브러리인 리틀엘엠(LiteLLM)의 PyPI 패키지 공급망 침해 사건이다. 월간 9 천7 백만 회에 달하는 다운로드 수를 기록하며 수천 개의 AI 애플리케이션과 100 개 이상의 대형 언어 모델 제공자를 연결하는 핵심 미들웨어 역할을 해온 이 라이브러리의 버전 1.82.7 과 1.82.8 이 악성 코드로 오염된 사실이 밝혀지면서 전 세계 개발자들이 경계 태세에 들어갔다. 이 사건이 단순한 기술적 결함으로 치부되지 않고 큰 주목을 받는 이유는 리틀엘엠이 단순한 유틸리티가 아니라 클라우드 자격 증명, 모델 제공자 키, 통합 토큰 등 조직의 가장 가치 높은 비밀을 관리하는 제어판 역할을 하기 때문이다.

사건의 핵심은 두 버전이 서로 다른 방식으로 악성 페이로드를 탑재했다는 점에 있다. 버전 1.82.7 은 프록시 서버 파일에 위장된 코드를 포함하고 있었으나, 버전 1.82.8 은 파이썬 인터프리터가 시작될 때 자동으로 실행되는 리틀엘엠_이니트.pth 파일을 포함하고 있었다. 이 .pth 파일의 존재는 악성 코드가 임포트 문장을 호출하지 않아도 설치 즉시 실행될 수 있음을 의미하며, 이는 공격자가 시스템의 초기화 단계에서 SSH 키, AWS 및 GCP 자격 증명, 도커 설정, 심지어 암호화폐 지갑 데이터까지 수집하여 암호화한 뒤 외부 서버로 전송할 수 있게 했다. 이러한 공격 방식은 리틀엘엠이 AI 게이트웨이로서 갖는 전략적 위치를 악용한 것으로, 한 번의 설치만으로 전체 인프라의 보안이 뚫릴 수 있는 치명적인 약점을 드러냈다.

이러한 침해 사태가 발생한 배경에는 CI/CD 파이프라인에서 사용된 트라이비(Trivy) 보안 스캔 도구의 취약점이 있었음이 밝혀졌다. 리틀엘엠 팀은 공식적으로 유지보수 계정이 교체되고 compromised 된 패키지가 PyPI 에서 격리 및 삭제되었음을 발표하며, 현재는 새로운 버전으로의 전환과 노출된 자격 증명의 회전 작업을 권장하고 있다. 하지만 이 사건이 남긴 교훈은 단순한 패치나 롤백을 넘어선다. 개발자들은 이제 의존성 관리의 중요성을 다시금 깨닫게 되었으며, 컨테이너 환경의 고립성 부족과 복잡한 의존성 체인이 어떻게 공급망 공격의 통로가 될 수 있는지에 대한 깊은 성찰을 하고 있다.

앞으로 주목해야 할 점은 이 사건이 AI 인프라 보안의 새로운 표준을 정립하는 계기가 될지 여부다. 많은 전문가들이 이제 개발 환경을 단순한 샌드박스가 아닌, 심층 방어를 갖춘 완전한 격리 공간으로 전환해야 한다고 주장한다. 가상 머신 격리, 컨테이너 원시 기능, 허용 목록, 이그레스 필터 등 다양한 보안 장치를 결합한 환경이 필요하다는 의견이 지배적이다. 리틀엘엠 사태는 AI 에이전트 런타임이 요구하는 보안 수준과 개발 환경이 점차 수렴하고 있음을 시사하며, 앞으로는 패키지의 무결성을 검증하는 것뿐만 아니라 실행 환경 자체의 신뢰성을 확보하는 것이 AI 개발의 핵심 과제가 될 전망이다.