코딩 에이전트가 생성한 결과가 항상 동일한 정답을 보장하지 않는 시대가 열렸다. 기존에는 입력된 코드에 대해 명확한 참과 거짓을 가릴 수 있었지만, 생성형 AI 기반의 에이전트는 상황에 따라 다양한 유효한 해법을 제시한다. 이러한 비결정적 특성은 개발자들이 에이전트의 행동을 단순히 스크립트로 검증하거나 블랙박스처럼 판단하는 방식의 한계를 드러내게 만들었다. 이제 핵심 질문은 ‘결과가 맞는지’가 아니라 ‘행동이 타당한지’를 어떻게 증명하느냐로 이동했다.

이러한 변화가 주목받는 이유는 AI 코딩 도구가 단순한 자동화를 넘어 복잡한 의사결정 주체로 진화하고 있기 때문이다. 깃허블로그가 최근 다룬 바와 같이, 에이전트의 행동을 검증하기 위해 기존의 경직된 테스트 스크립트나 불투명한 판단 기준을 대체할 새로운 접근법이 필요하다. 특히 깃허브 코파일럿 코딩 에이전트와 같은 도구가 실제 업무 환경에 깊숙이 침투하면서, 개발자들은 에이전트가 내린 결정의 근거를 명확히 이해하고 신뢰할 수 있어야만 했다. 이는 단순히 코드가 실행되는지 여부를 넘어, 에이전트가 문제를 해결하는 논리 과정 자체가 투명해야 함을 의미한다.

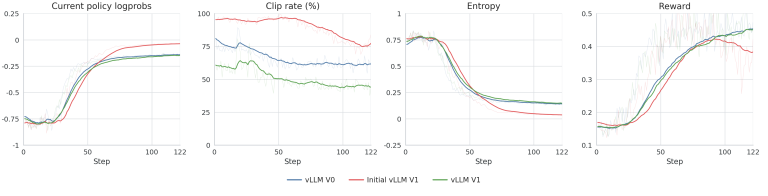

이를 해결하기 위해 등장한 개념이 바로 ‘지배적 분석’을 통한 신뢰 레이어 구축이다. 이 방식은 에이전트가 다양한 경로로 동일한 목표를 달성할 때, 그 결과가 특정 기준 내에서 일관된 성능을 보이는지를 분석한다. 단순히 정답과 오답을 나누는 이분법적 접근을 탈피하여, 에이전트의 행동 패턴이 얼마나 견고하고 예측 가능한지를 평가하는 구조를 만든 것이다. 개발자들은 이제 에이전트가 생성한 코드가 특정 조건에서 어떻게 변형될 수 있는지, 그리고 그 변형이 시스템 전체에 어떤 영향을 미치는지를 파악하는 데 집중하게 되었다.

앞으로 주목해야 할 점은 이러한 검증 방식이 소프트웨어 개발의 품질 기준을 어떻게 재정의할 것인가다. AI 에이전트의 신뢰성이 확보되지 않는 한, 자동화된 코딩은 여전히 보조 수단에 머물 수밖에 없다. 하지만 지배적 분석과 같은 새로운 검증 메커니즘이 보편화되면, 개발자는 에이전트의 행동을 더 넓은 맥락에서 이해하고 통제할 수 있게 된다. 이는 단순한 기술적 진보를 넘어, 인간과 AI가 협업하는 방식의 근본적인 변화를 예고하며, 향후 AI 기반 개발 플랫폼의 보안과 안정성 기준을 새롭게 설정할 중요한 분기점이 될 것이다.