지금까지 AI 에이전트가 세상을 이해하는 방식은 마치 여러 전문가가 번갈아 말을 잇는 것과 같았습니다. 이미지를 보고, 소리를 듣고, 텍스트를 해석하는 과정이 서로 다른 모델 사이를 오가며 데이터를 전달하다 보니, 시간과 맥락이 흐트러지는 경우가 많았습니다. 하지만 엔비디아가 최근 공개한 네모트론 3 나노 오미는 이러한 단절을 끊고 시각, 오디오, 언어 능력을 하나의 시스템으로 통합했습니다. 이는 단순한 기술의 합치를 넘어, AI 가 더 빠르고 똑똑하게 반응할 수 있는 새로운 시대를 연다는 점에서 주목받고 있습니다.

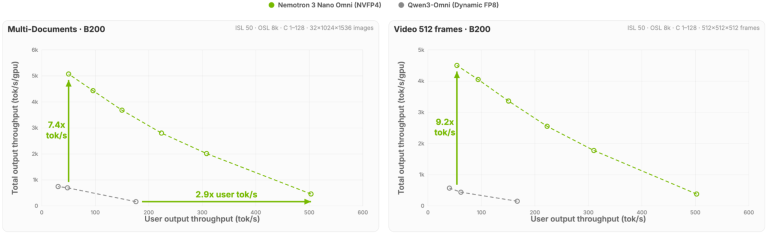

이 모델이 뜨거운 관심을 끄는 핵심은 압도적인 효율성입니다. 기존 오픈형 멀티모달 모델 대비 9 배 높은 처리량을 보여주면서도 정확도를 유지한다는 점은 기업과 개발자들에게 큰 매력으로 작용합니다. 특히 복잡한 문서 이해나 비디오, 오디오 분석 분야에서 기존 리더보드 6 개를 석권하며, 비용은 낮추고 확장성은 높인 실질적인 생산 경로를 제시했습니다. 텍스트, 이미지, 음성, 영상, 차트 등 다양한 입력을 받아 텍스트로 출력하는 이 모델은 AI 에이전트 시스템의 ‘눈과 귀’ 역할을 수행하며, 다른 모델들과 협력해 더 정교한 판단을 내릴 수 있게 합니다.

실제 시장 반응도 빠르게 움직이고 있습니다. Aible, Applied Scientific Intelligence, Eka Care, Foxconn, H Company, Palantir, Pyler 등 AI 및 소프트웨어 기업들이 이미 이 모델을 도입하기 시작했습니다. 델 테크놀로지스, 도큐사인, 인포시스 같은 글로벌 기업들도 참여하며 생태계가 빠르게 확장되고 있습니다. 이는 네모트론 3 나노 오미가 단순한 실험실 수준의 기술을 넘어, 실제 비즈니스 현장에서 즉시 활용 가능한 안정성을 갖췄음을 의미합니다.

앞으로 주목해야 할 점은 이 모델이 어떻게 다양한 산업의 흐름을 바꿀지입니다. 30B-A3B 하이브리드 MoE 구조와 256K 컨텍스트 윈도우를 갖춘 이 기술은 2026 년 4 월 28 일 허깅페이스와 오픈라우터, 엔비디아 공식 플랫폼 등을 통해 공개될 예정이며, 25 개 이상의 파트너 플랫폼을 통해 확산될 것입니다. 개발자들은 이제 별도의 모델 간 데이터 손실 없이, 하나의 통합된 두뇌로 복잡한 작업을 처리할 수 있게 되었습니다. AI 에이전트가 더 자연스럽고 즉각적으로 인간의 감각을 모방하며 작동하는 날이 머지않은 것 같습니다.