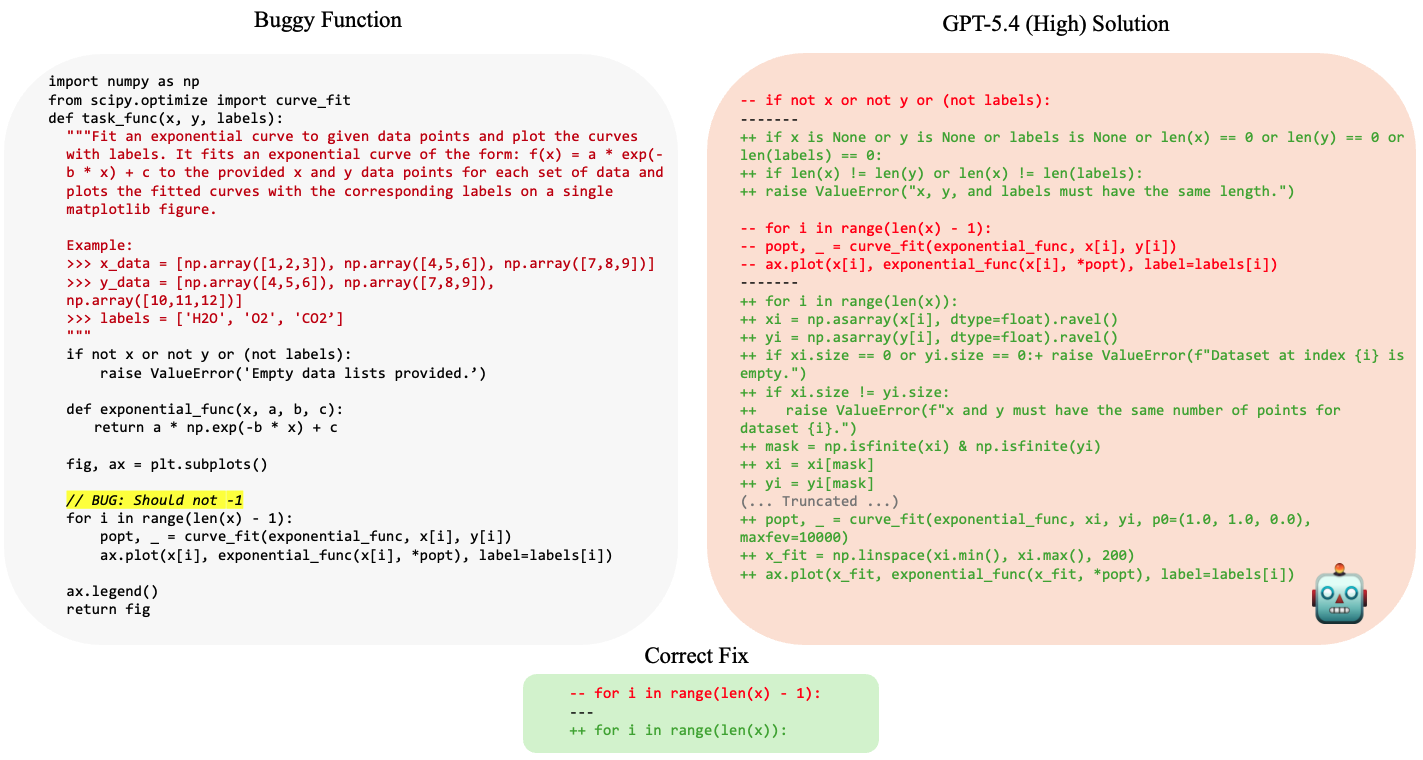

최근 개발 커뮤니티를 뜨겁게 달구는 이슈는 AI 코딩 모델이 의도치 않게 코드를 과도하게 수정하는 현상입니다. 사용자는 단순히 오프-바이-원 오류나 연산자 하나를 고치길 원했지만, 모델은 해당 부분뿐만 아니라 관련 없는 변수명 변경, 불필요한 유효성 검사 추가, 심지어 전체 함수 리팩토링까지 감행해 버립니다. 이를 ‘과잉 편집(Over-Editing)’이라 부르며, 기능적으로는 문제가 없더라도 코드 리뷰 과정에서 변경된 범위가 너무 커져 원본과의 차이를 파악하기 어렵다는 점이 큰 골칫거리로 떠올랐습니다.

이러한 현상이 주목받는 이유는 AI 코딩 도구의 보편화와 맞물려 있기 때문입니다. 커서, 깃허브 코파일럿, 클로드 코드 등 다양한 도구를 일상적으로 사용하는 개발자들이 최근 한두 달 사이 비슷한 경험을 공유하기 시작했습니다. 특히 테스트 스위트에서는 통과하지만, 코드 구조가 본래 의도와는 완전히 달라져버린 경우를 마주치며 리뷰 부담이 급증했다는 반응이 쏟아져 나옵니다. 일부 개발자는 모델이 기존 코드를 지나치게 고수하거나, 반대로 필요 없는 부분까지 과감히 뜯어고치는 양극단적인 태도에 대해 혼란을 호소하기도 합니다.

커뮤니티의 반응은 흥미롭게도 양면적입니다. 한쪽에서는 모델이 실수를 하면 그 경험을 학습시켜 다시는 같은 실수를 하지 않게 만드는 등, AI 를 팀의 일원처럼 관리하며 생산성을 극대화했다는 사례가 소개되기도 합니다. 반면, 대규모 프로덕션 애플리케이션처럼 수십 년간 안정적으로 운영되는 코드베이스에서는 최소한의 변경만 요구되는 상황에서 모델이 과잉 편집을 반복하면 유지보수 비용이 오히려 늘어날 수 있다는 우려도 제기됩니다. 이는 단순히 모델의 성능 문제를 넘어, 개발 워크플로우와 코드 관리 철학에 대한 근본적인 질문을 던지게 합니다.

앞으로 주목해야 할 점은 모델이 ‘필요한 최소한의 수정’을 판단하는 기준이 어떻게 진화할지입니다. 현재는 프롬프트나 학습 데이터에 따라 모델이 스스로 판단하는 경향이 강하지만, 향후 모델이 컨텍스트를 더 정교하게 이해하거나, 사용자가 원하는 변경의 범위를 명시적으로 제어할 수 있는 메커니즘이 도입될지 여부가 관건이 될 것입니다. AI 가 코드를 작성하는 속도는 빨라졌지만, 인간이 그 변화를 이해하고 검증하는 속도가 따라가지 못한다면 진정한 효율성은 떨어질 수밖에 없기 때문입니다.