최근 인공지능에 대한 관심이 높아지면서, 단순히 결과를 사용하는 것을 넘어 그 작동 원리를 알고 싶어 하는 사람들이 급증하고 있습니다. 특히 안드레이 카파티의 기술적 강의를 바탕으로 제작된 ‘LLM 작동 원리 시각화 가이드’가 개발자 커뮤니티인 해커뉴스를 중심으로 큰 화제를 모으고 있습니다. 이 도구가 주목받는 가장 큰 이유는 막연하게만 느껴졌던 거대 언어 모델의 내부 과정을 눈으로 직접 확인할 수 있게 해주기 때문입니다.

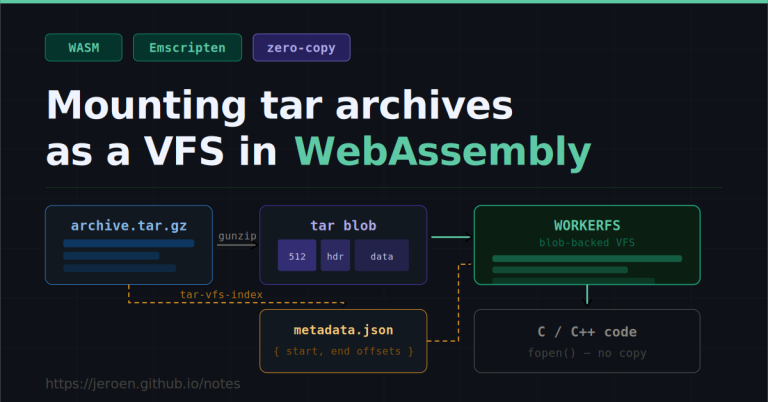

이 시각화 가이드는 웹상에서 수집된 방대한 텍스트가 어떻게 정제되고, 토큰이라는 숫자 단위로 변환되는지부터 시작해, 트랜스포머 신경망이 어떻게 다음 단어를 예측하도록 학습되는지까지 전체 흐름을 한눈에 보여줍니다. 예를 들어, 44 테라바이트에 달하는 데이터가 어떻게 약 15 조 개의 토큰으로 압축되는지, 그리고 바이트 페어 인코딩이라는 알고리즘이 어떻게 빈도 높은 단어 쌍을 반복적으로 병합하여 어휘를 확장해 나가는지 구체적인 숫자와 함께 설명합니다. 과거에는 추상적인 개념으로만 설명되던 ‘손실 함수’가 감소하며 모델이 학습해 나가는 과정도 그래프와 애니메이션을 통해 직관적으로 전달됩니다.

하지만 이 가이드가 완벽하지는 않다는 지적도 함께 제기되고 있습니다. 초기 버전에서는 44 테라바이트 데이터를 단일 하드 드라이브에 담을 수 있다는 표현이 사용되기도 했으나, 이는 일반적인 소비자용 하드 드라이브 용량과 비교했을 때 다소 과장된 설명이라는 지적을 받으며 수정되었습니다. 또한, 가장 핵심적인 메커니즘 중 하나인 어텐션 메커니즘이 빠져 있다는 점과, 토큰화 과정에서 기존 토큰이 사라지는 것이 아니라 새로운 토큰이 추가되는 과정임을 명확히 하지 못했다는 비판도 존재합니다. 이러한 피드백은 오히려 커뮤니티가 이 도구를 단순한 홍보물이 아닌, 함께 발전시켜 나가는 살아있는 학습 자료로 인식하고 있음을 보여줍니다.

이처럼 복잡한 AI 기술을 일상적인 비유와 시각적 요소로 풀어낸 가이드가 뜨는 현상은, 이제 인공지능이 더 이상 전문가만의 전유물이 아니라 일반인도 그 원리를 이해하고 활용해야 할 시대가 왔음을 의미합니다. 앞으로는 단순한 원리 설명을 넘어, 실제 데이터가 최종 단계에서 어떻게 특정 작업에 적용되고 예측 결과에 영향을 미치는지까지 더 깊이 있게 다루어질 것으로 예상됩니다. 인공지능의 블랙박스를 열어보는 이 여정은 기술에 대한 두려움을 줄이고, 더 나은 활용을 위한 첫걸음이 될 것입니다.